Lurking

Still mitlesen statt mitdiskutieren bei Onlinedebatten: Laut Forschern machen das eher Frauen als Männer. Das hat Gründe. © imago / imagebroker / Axel Bückert

Online schweigen: Populär, aber mit negativen Folgen

An Onlinedebatten beteiligt sich nur eine Minderheit der Nutzenden – der Rest liest still mit. Wichtigster Grund: Angst vor Hass. Diese eingeschränkte Teilhabe hat alarmierende Auswirkungen – im Netz wie außerhalb. Welche Ideen gibt es dagegen?

Das Internet ging mit einer großen Hoffnung einher: Alle sollten ohne großen Aufwand öffentlich mitreden können. Doch schnell zeigte sich: Eher wenige tun es. Ein großer Teil der Nutzenden etwa von Social-Media-Plattformen beteiligt sich nicht an Diskussionen, verteilt keine Likes, teilt nichts – und bleibt für die jeweiligen Communities weitgehend unsichtbar, liest lediglich mit.

Dieses Verhalten hat verschiedene Gründe. Der häufigste und stärkste ist Angst. Angst davor, mit toxischem Verhalten oder gar mit Hass konfrontiert zu werden. Oft aus Erfahrung. Das führt dazu, dass sich nur ein kleiner Ausschnitt der Gesellschaft überhaupt an Online-Debatten beteiligt – und diese so oft ein verzerrtes Bild wiedergeben.

Diese Mechanismen wirken sich auch – in teils alarmierender Weise – in der Offline-Welt aus. Welche Möglichkeiten gibt es, dagegen vorzugehen und mehr Menschen zu motivieren, sich online konstruktiv einzubringen?

Inhalt

Was ist Lurking?

Lurken bedeutet so viel wie „im Verborgenen bleiben“. Etwa dadurch, „dass man in sozialen Medien Inhalte liest, aber nichts liket, kommentiert, teilt oder auf andere Weise eine sichtbare Spur hinterlässt“, erklärt Gina Sipley, Medienwissenschaftlerin an der State University New York, die das Phänomen des „digitalen Schweigens“ erforscht.

Zahlen dazu gibt es schon länger. Um das Jahr 2000 kamen interne Untersuchungen von Websites und wissenschaftliche Schätzungen zu dem Ergebnis: Bis zu 90 Prozent der Online-Aktivität besteht aus stillem Mitlesen.

Wichtig dabei: Öffentlich sichtbare Kennzahlen etwa bei sozialen Netzwerken – zu Interaktionen wie Kommentaren, Likes, geteilten Inhalten – erfassten nur 10 Prozent der tatsächlichen Nutzeraktivität, erklärt Medienwissenschaftlerin Gina Sipley. Der Großteil passiere im Verborgenen: Dinge wie Lesedauer, mit der Maus über Inhalte fahren, auf Links klicken, Bilder vergrößern, scrollen oder auf dem Handy tippen.

Angesichts von etwa 90 Prozent der Nutzer, die lediglich still mitlesen, könnten die öffentlich sichtbaren Kennzahlen irreführend sein, so Sipley.

Welche Gründe gibt es fürs stille Mitlesen?

Die Studie des kanadischen Informationswissenschaftlers Blair Nonnecke Anfang der 2000er-Jahre zeigt Gründe, warum Menschen online schweigen – wie beispielsweise: Das Mitlesen reicht ihnen aus, sie sind schüchtern, haben keine Zeit oder wollen chaotische Diskussionen nicht noch mehr überfrachten.

Medienwissenschaftlerin Gina Sipley fand in ihrer 2024 auch als Buch erschienenen Studie als weitere Motive heraus: Viele der still Mitlesenden wollen verstehen.

Bei anderen Befragten war die Entscheidung für das Schweigen und gegen das Kommentieren, Liken oder Teilen eine bewusste, so Sipley: Sie wollten damit nicht befördern, dass von ihnen als politisch gefährlich eingestufte Posts weiterverbreitet werden.“

Ein sehr häufiger Grund, warum Menschen es vermeiden, sich online zu äußern, ist Angst. In der Studie “Lauter Hass – leiser Rückzug" (2024) gab jede zweite Person an, sich aus Angst weniger an Diskussionen zu beteiligen.

Vielfach wohl aus Erfahrung: Denn aus der repräsentativen Befragung – herausgegeben unter anderem von der Gesellschaft für Medienpädagogik und Kommunikationskultur sowie der gemeinnützigen Organisation HateAid als Teil des Kompetenznetzwerks gegen Hass im Netz – geht hervor: Fast jede zweite Person wurde schon einmal online beleidigt. 15 Prozent der Studienteilnehmer ab 16 Jahren wurden demnach im digitalen Raum bereits Opfer von Hass.

Mehr als die Hälfte der Studienteilnehmer gibt an, sich online weniger zu ihrer politischen Meinung zu bekennen und sich generell weniger an Diskussionen zu beteiligen – der Grund: Hass im Netz.

Gibt es Gruppen, die im Web besonders oft angegriffen werden?

Besonders häufig von Hass im Netz betroffen sind Personen mit sichtbarem Migrationshintergrund, queere Menschen und junge Frauen.

Häufig seien auch Politikerinnen und Politiker das Ziel von Hass, beobachten 60 Prozent der in der Studie “Lauter Hass – leiser Rückzug” befragten Internetuser. Ebenfalls betroffen seien Journalistinnen und Aktivisten.

Welche Folgen hat es, dass sich nur eine Minderheit der User an Debatten beteiligt?

Der Hass im Netz hat Konsequenzen – online und in der Welt außerhalb des Webs. Im Worst-Case-Szenario ziehen sich Menschen komplett aus dem politischen Diskurs zurück.

Weitere Folge: Dem Diskurs drohe eine Polarisierung, erklärt Netzwerkwissenschaftler Philipp Lorenz-Spreen, der zu Digitalisierung und Gesellschaft forscht. Wenige, oft extreme Stimmen kämen überproportional vor. Auch äußerten sich etwa viele Männer, Frauen dagegen weniger.

So erscheine eine Diskussion beispielsweise in sozialen Netzwerken leicht als etwas, was den öffentlichen Diskurs widerspiegelt – basiere in Wirklichkeit aber womöglich auf eher extremen Minderheitsmeinungen.

Wenn diese verzerrte Diskussion aus Social Media in andere Medien, vielleicht in die Nachrichten gelangt, werde sie plötzlich „irgendwie Realität“, so Lorenz-Spreen. „Und irgendwann hat man diese verzerrte Diskussion überall. Und das wird dann Teil unserer Gesellschaft.“

Auch reduziere der Eindruck, große Teile der Gesellschaft verträten diese – eigentlich extreme – Meinung, die Hemmungen, diese Meinung auch im Offline-Raum stärker zu vertreten. Das erklärt Marc Ziegele, Professor für Kommunikations- und Medienwissenschaften an der Heinrich-Heine-Universität in Düsseldorf.

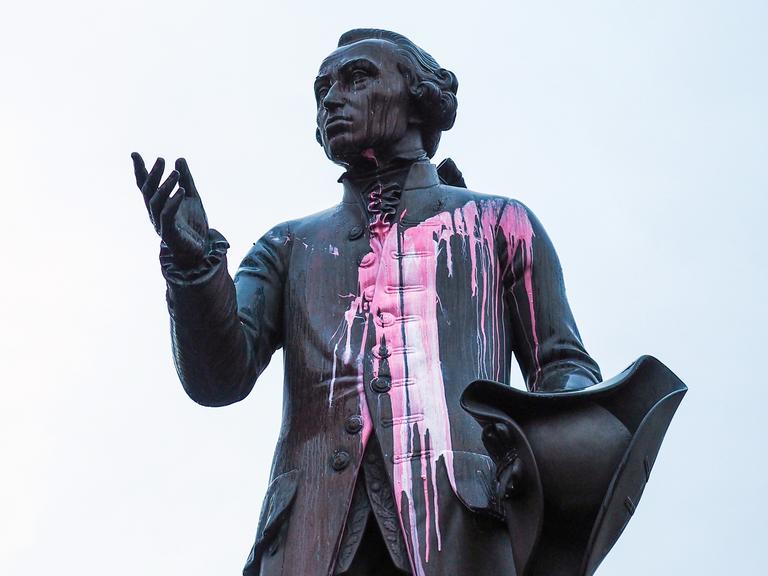

Und der Hass in Kommentarbereichen hat – neben dem möglichen Rückzug von Menschen – weitere Auswirkungen auf die Userinnen und User, selbst auf die, die lediglich still mitlesen. Das Lesen solcher Kommentare könne unbewusste Vorurteile gegenüber den Gruppen, die darin verunglimpft werden, verstärken, so Ziegele.

Eine Studie zeige, dass das Lesen von Hasskommentaren die Bereitschaft sich zum Beispiel für Geflüchtete einzusetzen, zu spenden oder für anderes Engagement verringern kann.

Was kann man tun, um mehr Menschen zur Online-Teilnahme zu bewegen?

Die Gefahr einer verzerrten öffentlichen Diskussion hat auch mit der Funktionsweise der meisten Plattformen zu tun: Sie belohnen, was polarisiert: Empörung, Zuspitzung, Streit. Inhalte und Stimmen, die zum stillen Nachdenken anregen, haben es schwer – oder verstummen.

Doch das ginge auch anders. Netzwerkwissenschaftler Philipp Lorenz-Spreen sammelt mit der Forschungsgruppe Pro Social Design Network Wissen zu alternativen Plattform-Designs.

Zum Beispiel Ideen für positives soziales Feedback, wie einen Danke-Button. Um auszudrücken: Ich stimme zwar nicht zu, finde es aber gut, dass das eingebracht wurde. Oder eine Art Abzeichen für besonders konstruktive Kommentare.

Ein anderer Ansatz: Plattformbetreiber könnten für mehr Transparenz sorgen und neben den Likes für einen Beitrag auch sichtbar machen, wie viele Personen insgesamt den Beitrag gesehen haben.

KI schlägt Variante ohne Beleidigungen vor

Auch der Aufbau von Plattformen hat großen Einfluss auf die Kommunikationskultur: Für Philipp Lorenz-Spreen ist Reddit ein interessantes Beispiel. Die durch Upvotes und Downvotes und in Kommentarbäumen strukturierten Kommentarspalten wirkten oft konstruktiver als nach Likes sortierte Kommentare.

Künstliche Intelligenz könnte eine weitere Unterstützung sein. Tahireh Panahi, Juristin und Expertin für Plattformregulierung an der Universität Kassel, schlägt vor, Plattformen zu verpflichten, auf spielerische Weise und mit KI-Hilfe Medienkompetenz zu vermitteln.

In der Entwicklung befindet sich bei Marc Ziegele an der Heinrich-Heine-Universität Düsseldorf ein Tool, das Verfassern von Posts und Kommentaren Vorschläge macht, ohne Beleidigung auszukommen – und ohne die Kernbotschaft zu entfernen. Ein wichtiger Punkt ist auch: Bessere Moderation von Diskussionen, auch mithilfe von KI – damit der Ton gar nicht erst toxisch wird.

Doch es gebe auch Eigenverantwortung der Nutzenden, betont Medienpädagoge Stephan Schölzel und mahnt Zivilcourage auch online an.

abr