Werden die Plattformen endlich erwachsen?

17:11 Minuten

Die Rolle von Facebook, YouTube und Co. lässt sich zunehmend als Gestalter von Gesellschaften beschreiben. Lange Zeit haben die Plattformen diese Verantwortung abgetan und sich als reine Unterhaltungsplattformen oder große Familie gesehen. Aber jetzt kommt Bewegung in das Thema.

Lange Zeit gab es viele Freiheiten in den Sozialen Netzwerken. Extreme Nischenthemen erhielten durch Algorithmen und eine kleine Gruppe sehr aktiver User mehr Aufmerksamkeit als angebracht wäre. Selbst eine Einzelperson konnte durch das wiederholte Betrachten ein und desselben Videos die Relevanz des Videos für andere erhöhen. Der Algorithmus beurteilte nicht den Inhalt, sondern schaute einzig und allein darauf: was wurde oft angeschaut?

Der Vorwurf, dass YouTube einem zu schnell Videos vorschlägt, die User radikalisieren könnten, hängt schon lange im Raum. Auch Themen wie die Flat Earth-Theorie oder Verschwörungstheorien zu 9/11 erhielten dadurch viel zu viel Aufmerksamkeit.

Die Plattformen reagieren

Ende Januar veröffentlichte das YouTube-Team auf dem hauseigenen Blog einen Beitrag zum Thema "Verbessern des Empfehlungsalgorithmus".

YouTubes Team will mit einem verbesserten Vorschlagsalgorithmus verhindern, dass Videos zu Verschwörungstheorien zu viel Verbreitung finden.

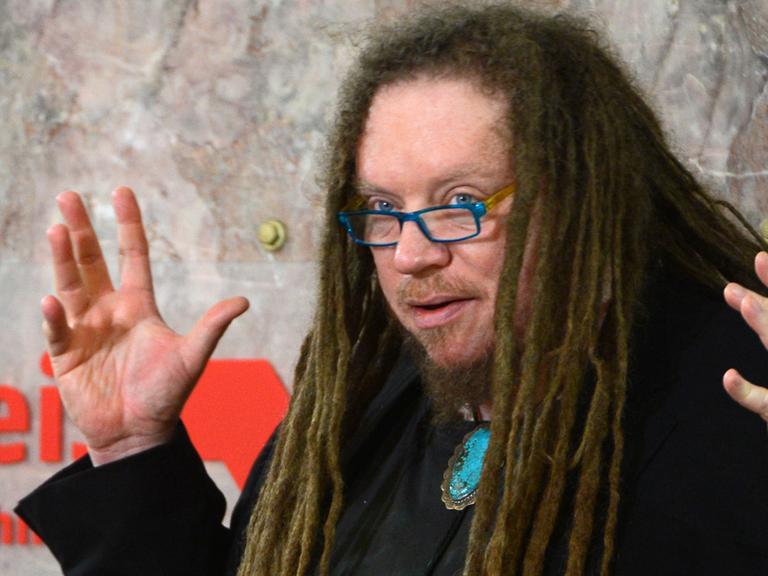

Diese können nicht nur alleine seltsame Weltbilder verbreiten, sie haben noch einen zweiten Effekt. Jonas Kaiser ist Kommunikationswissenschaftler und hat zum Einfluß von YouTube auf die öffentliche Sphäre gearbeitet. Dabei kam zum Vorschein, dass es eine Schnittmenge zwischen Verschwörungstheorien und rechtsextremen Inhalten gibt. "Ich würde sagen, da gibt es in der Regel diese Überlappung, dass eben gerade auch rechtsextreme und rechtsradikale Akteure sich auch Verschwörungstheorien bemühen um das eigene Weltbild zu erklären beziehungsweise den eigenen Rassismus zu erklären."

Gleichzeitig plädiert Jonas Kaiser dafür YouTubes Verantwortung nicht zu sehr zu überhöhen: "Ich glaube wir müssen aufpassen so viel Verantwortung auf YouTube zu geben und uns selbst komplett rauszunehmen und gleichermaßen sollten wir YouTube dann bei der Verantwortung packen, wenn etwas wirklich nicht so richtig läuft, wie wir uns das vorstellen."

Menschen hätten schon immer Verschwörungstheorien angehangen. Durch das Internet können diese leichter verbreitet werden. Der Ansatz von YouTube, durch einen veränderten Algorithmus die Verbreitung ein wenig einzuschränken, findet Jonas Kaiser gut: "Ich halte das auf jeden Fall für einen Schritt in die richtige Richtung. Inwieweit das dann tatsächlich funktioniert, inwieweit das Einfluss darauf haben wird, wie der Nutzer und die Nutzerin YouTube nutzen, darüber können wir natürlich nichts sagen."

Beugt sich YouTube dem gesellschaftlichen Druck?

Schritt für Schritt werden nun Einschränkungen vorgenommen, welche Art von Videos empfohlen werden. Die Anbieter beginnen damit Verantwortung für den Schutz der Userinnen und User zu übernehmen. Ist das eine Reaktion auf gesellschaftlichen Druck? Für Jonas Kaiser spricht einiges dafür: "Ich halte es für plausibel, dass die Reaktion YouTubes eine Reaktion auf politischen Druck ist, auf gesellschaftlichen Druck, der sowohl in Europa als auch in den USA stetig zunimmt. In Europa noch mit mehr politischem Verve, aber gleichermaßen merkt man auch in den USA, dass der Wille zu Regulierung stärker wird und dass die Plattform mehr unternehmen um dem vorzubeugen."

Ob sich durch den veränderten Algorithmus auch tatsächlich Veränderungen bei der Verbreitung der Verschwörungstheoretischen Videos ergibt, ist noch nicht abzusehen, kommt laut Jonas Kaiser aber auch viel zu spät. Er ist aber der Ansicht, dass YouTube einen noch viel genaueren Blick auf den Algorithmus werfen sollte und verstehen müsste, dass die verschiedenen Inhalte auch unterschiedlich verarbeitet werden müssen: "Ich würde ich mir wünschen, dass YouTube versteht, dass Politik einfach ein anderes Feld ist, wo diese gängige Idee von ‘Wir empfehlen einfach immer weitere Videos" und die dann schnell im verschwörungstheoretischen oder auch rechten Bereich landen, dass sie da Einhalt gebieten, dass sie da verstehen, dass Algorithmen einfach anders zu funktionieren haben, weil man eine andere gesellschaftliche Verantwortung hat als beispielsweise bei Computerspielen oder Sport."