Maschinen statt Menschen

Je mehr Daten zur Verfügung stehen, desto weniger sollten wir uns auf Menschen verlassen, finden die Erfinder des Supercomputers Watson. Denn das menschliche Urteilsvermögen steckt voller Fehler. So urteilt ein hungriger Richter anders als ein satter. Entscheiden bald Maschinen?

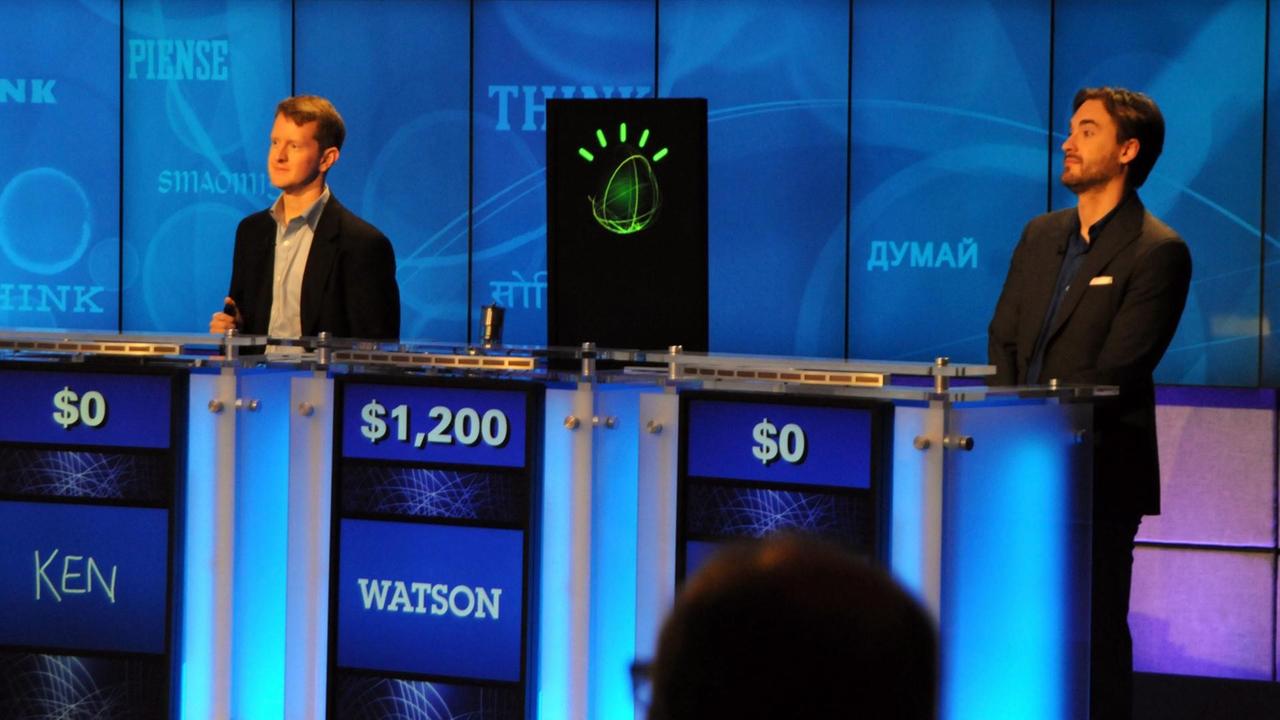

Im Jahr 2011 trat IBMs Supercomputer Watson in der US-amerikanischen Ausgabe der Traditions-Quizshow Jeopardy an, bei der je drei Kandidaten versuchen, die richtige Frage zu Antworten in verschiedenen Kategorien zu finden. Watson gewann haushoch – gegen die beiden erfolgreichsten Jeopardy-Kandidaten aller Zeiten, Brad Rutters und Ken Jennings.

Seinen Gewinn spendete Watson freundlicherweise an zwei Wohltätigkeitsorganisationen. Seitdem hat der Supercomputer viele Hüte aufgehabt. Er diagnostiziert Krankheiten, steuert Social Media Kampagnen, und übersetzt Texte. Dazu wertet er Daten aus und setzt sie in Entscheidungen um. Doch für gute Entscheidungen muss man nicht nur Informationen auswerten – auch Kreativität ist gefragt. So auch der Gedanke hinter einem eher ungewöhnlichen IBM-Projekt.

IBMs Watson gewinnt im Jeopardy gegen Ken Jennings und Brad Rutter. © picture alliance / dpa / IBM

Florian Pinel, Chefingenieur bei IBM und einer der Erfinder des Projekts Chef Watson:

"Kognitives Kochen haben wir uns vor etwa fünf Jahren ausgedacht, kurz nach Watsons Erfolg bei Jeopardy."

"Kognitives Kochen haben wir uns vor etwa fünf Jahren ausgedacht, kurz nach Watsons Erfolg bei Jeopardy."

Die Idee hinter kognitivem Kochen:

"Wir dachten, ein Service, der noch fehlt, ist etwas, das mit Kreativität zu tun hat. Kann Watson Nutzern helfen, kreativ zu sein? Wir haben uns zuerst auf Essen konzentriert, weil das vielen Menschen wichtig ist. Wir dachten, es müsste möglich sein, ein Programm zu entwickeln, das nicht nur Zutaten zufällig miteinander kombiniert, sondern auch einschätzen kann, ob diese Kombinationen gut schmecken."

"Wir dachten, ein Service, der noch fehlt, ist etwas, das mit Kreativität zu tun hat. Kann Watson Nutzern helfen, kreativ zu sein? Wir haben uns zuerst auf Essen konzentriert, weil das vielen Menschen wichtig ist. Wir dachten, es müsste möglich sein, ein Programm zu entwickeln, das nicht nur Zutaten zufällig miteinander kombiniert, sondern auch einschätzen kann, ob diese Kombinationen gut schmecken."

Kognitive Rezepte

Florian Pinel fütterte den Supercomputer mit Informationen zur chemischen Zusammensetzung von Lebensmitteln. Auf dieser Basis errechnete Watson kognitive Rezepte – wie ein Koch mit einem Diplom in Lebensmittelchemie.

Florian Pinel: "Es gibt eine Theorie, die besagt: Je mehr Geschmacksstoffe die Zutaten miteinander teilen, desto besser passen sie zusammen."

Die Rezepte entwickelte Pinel weiter, mit Hilfe professioneller Köche am Institute of Culinary Education in New York. Heraus kamen ungewöhnliche Kombinationen.

Die Rezepte entwickelte Pinel weiter, mit Hilfe professioneller Köche am Institute of Culinary Education in New York. Heraus kamen ungewöhnliche Kombinationen.

Institute of Culinary Education in New York.© Imago / Agencia EFE

Ein Beispiel: österreichische Schokoladen-Burritos. Die Zutaten: Hackfleisch, dunkle Schokolade, Aprikosenpüree und Edamame. Ob diese Kombination begeistert oder nicht, ist Geschmackssache – und wenn das Experiment fehlschlägt, dann hat das keine weitreichenderen Konsequenzen als enttäuschte Esser.

Doch auch in anderen Bereichen sind schon längst Algorithmen am Werk, die Menschen Entscheidungen abnehmen – und oft tun sie das sehr gut, sagt Andrew McAfee, Mitgründer der Initiative für Digitale Ökonomie am Massachusetts Institute of Technology:

"Wir leben nicht mehr in einer Welt mit kleinen Datenmengen – wir leben in einer Big Data-Welt. Und wir müssen nicht mehr mit einfachen Algorithmen arbeiten, wir können hochentwickelte benutzen. Der Unterschied zwischen menschengemachten Entscheidungen und Einschätzungen und denen, die Computer, Big Data und Algorithmen generieren, diese Lücke wird immer größer."

"Wir leben nicht mehr in einer Welt mit kleinen Datenmengen – wir leben in einer Big Data-Welt. Und wir müssen nicht mehr mit einfachen Algorithmen arbeiten, wir können hochentwickelte benutzen. Der Unterschied zwischen menschengemachten Entscheidungen und Einschätzungen und denen, die Computer, Big Data und Algorithmen generieren, diese Lücke wird immer größer."

Daten statt Menschen

Die logische Folge, findet der Wirtschaftswissenschaftler: Je mehr Daten zur Verfügung stehen, desto weniger sollten wir uns auf Menschen verlassen. Denn das menschliche Urteilsvermögen steckt voller Fehler. Wir sind voreingenommen und befangen – und oft ist uns das nicht einmal bewusst. Andrew McAfee:

"Die Wikipedia-Liste über kognitive Verzerrungen hat, glaube ich, 175 Einträge."

In der englischen Ausgabe zumindest. Zum Beispiel der confirmation bias, der Bestätigungsfehler – also die Neigung dazu, Informationen so zu interpretieren, dass sie die eigene Meinung bestärken. Oder der Dunning-Krüger-Effekt – der erklärt, warum sich so gut wie alle Menschen für überdurchschnittlich gute Autofahrer halten. Andrew McAfee:

"Es gibt eine riesige Liste solcher Fehler in unserem Denken, in unserer Entscheidungsfindung. Und es gibt viele faszinierende Studien, die zeigen, dass diese Fehler sehr schädlich sein können."

Wenn der Richter Hunger hat

Als Beispiel nennt McAfee die Entscheidungen, die Bewährungsausschüsse treffen. Sie sind maßgeblich von einem Faktor abhängig, der keine Rolle spiele sollte, nämlich dem Blutzuckerspiegel des Richters. Eine israelische Studie aus dem Jahr 2011 zeigte: Die Wahrscheinlichkeit, dass jemand auf Bewährung freikommt, fiel von 65 Prozent direkt nach dem Mittagessen auf fast null Prozent kurz vor der nächsten Pause. Andrew McAfee:

"Wenn man die Richter fragt, hat dein Blutzuckerspiegel deine Entscheidung beeinflusst? Dann sagen sie natürlich nein."

Selbstverständlich sind auch Algorithmen nicht perfekt – sie können ihre eigenen kognitiven Verzerrungen entwickeln. Forscher der Princeton University entwickelten einen Assoziationstest für künstliche Intelligenz, ähnlich dem Impliziten Assoziationstest für Menschen, der unbewusste Vorurteile aufdeckt.

Die Princeton-Studie zeigte: Auch Computer neigen dazu, Berufe wie Wissenschaftler, Ingenieur und Programmierer eher Männern zuzuordnen. Krankenpfleger, Bibliothekare und Lehrer sind in Roboteraugen eher weiblich. Der Grund sind die Datensätze, mit denen Algorithmen trainiert werden. Andrew McAfee:

"Wenn wir den Algorithmen fehlerhafte Daten geben, dann werden sie auch falsche Berechnungen machen. Das ist nichts Neues. Einer der ältesten Sprüche über Computer ist: garbage in, garbage out."

Der Computer als Kooperationspartner

Andrew McAfee möchte eins klarstellen: Es gibt noch genug Bereiche, in denen Computer nicht an den Menschen herankommen. Zum Beispiel machen sie regelmäßig Fehleinschätzungen, die der gesunde Menschenverstand niemals zulassen würde.

Im Dezember 2014 nahm ein Mann in einem Café in Sydney 17 Geiseln. Als die Menschen in der Umgebung versuchten, sich mit Uber-Fahrern in Sicherheit zu bringen, reagierte das dynamische Preismanagement des Dienstleisters auf die schlechtmöglichste Weise: Die Preise stiegen auf über hundert australische Dollar pro Fahrt. Schuld war ein Algorithmus, der automatisch auf die erhöhte Nachfrage reagierte. Für Uber ein PR-Desaster – und nur ein Beispiel dafür, warum man Computerentscheidungen nicht blind vertrauen sollte.

Doch wie können wir die überlegene Rechenkraft von Computern in unsere Entscheidungen integrieren, ohne uns nutzlos vorzukommen? Schließlich fühlen wir uns gerne als Experten und wir bilden uns viel darauf ein, dass das Bauchgefühl uns in die richtige Richtung leitet. Bei IBM spricht man gerne von augmented intelligence, also vermehrter Intelligenz, statt von künstlicher Intelligenz.

Die Idee dahinter: der Computer als Kooperationspartner. Ingenieur Florian Pinel erklärt das so:

"Professionelle Köche sollen sich von Chef Watson nicht genötigt fühlen, es ist ein Werkzeug, das Inspiration liefert. Es gibt einen Dialog zwischen den Köchen und Maschine, der Algorithmen sagt ihnen nicht, was sie tun sollen."

Denn selbst wenn Chef Watson noch so raffinierte Rezepte entwirft – das Essen ist immer noch reine Menschensache.